Artículo

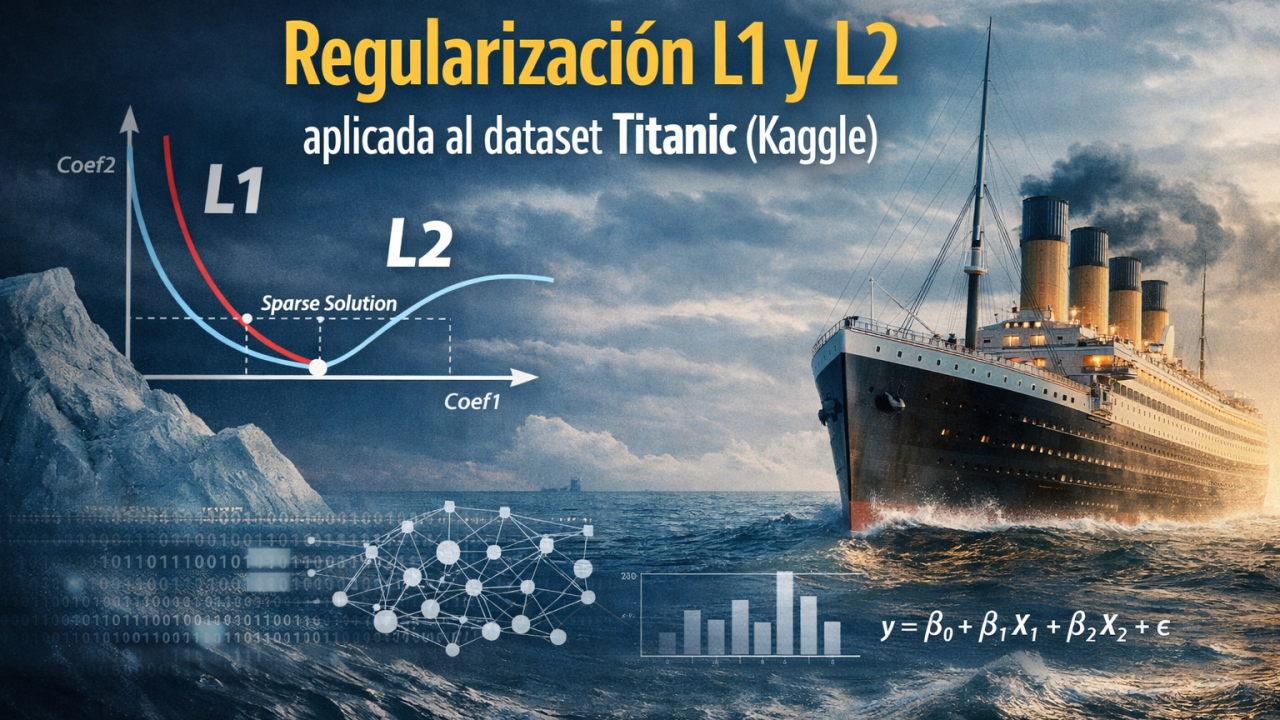

🚢 Regularización L1 y L2 aplicada al dataset Titanic (Kaggle)

El dataset del Titanic es uno de los clásicos en machine learning: pequeño, interpretable y suficientemente estructurado como para experimentar con modelos lineales.

En este notebook he construido un baseline utilizando Regresión Logística, centrándome en un aspecto concreto: el efecto de la regularización en la complejidad del modelo.

El objetivo no era maximizar el score en Kaggle, sino entender qué está ocurriendo internamente cuando regularizamos, además de construir un "primer modelo mínimo viable" para ir iterando en mejores soluciones.

¿Por qué Regresión Logística? Porque resolveré con distintos algoritmos de machine learning en sucesivas entradas, para ilustrar distintos enfoques y aproximaciones al problema.

1️⃣ Punto de partida: muchas variables, poca estructura

Tras el preprocesamiento inicial (One Hot Encoding, variables derivadas, etc.), el modelo contaba con un número considerable de características.

En datasets pequeños como Titanic (~800 muestras), esto introduce un riesgo claro:

- Alta dimensionalidad

- Posible sobreajuste

- Incremento innecesario de varianza

Aquí es donde entra la regularización.

2️⃣ Regularización L1: selección automática de variables

Entrenando una Regresión Logística con penalización L1 y un valor pequeño de C (regularización fuerte), el modelo redujo automáticamente el espacio de características hasta quedarse únicamente con tres variables activas:

- Sex_male

- Pclass

- Title_Mr

Todos los demás coeficientes se redujeron exactamente a cero.

Este resultado es especialmente interesante porque demuestra que gran parte de las variables generadas inicialmente no aportaban señal robusta, sino complejidad adicional.

La regularización L1 actuó como un mecanismo automático de selección de variables.

3️⃣ Regularización L2: control suave de la varianza

A continuación entrené un modelo con penalización L2, utilizando únicamente esas tres variables seleccionadas.

A diferencia de L1, L2 no elimina coeficientes, sino que reduce su magnitud. Es un mecanismo más suave de control de complejidad.

Los resultados confirmaron algo relevante:

- El rendimiento se mantuvo competitivo.

- El modelo no necesitaba alta dimensionalidad.

- La mayor parte de la señal del problema estaba concentrada en muy pocas características.

4️⃣ Interpretación de los coeficientes

Al tratarse de una Regresión Logística, los coeficientes representan cambios en el log-odds de supervivencia.

La interpretación es coherente con el contexto histórico del Titanic:

- Sex_male → reduce significativamente la probabilidad de supervivencia.

- Pclass → a peor clase socioeconómica, menor supervivencia.

- Title_Mr → refuerza el perfil de hombre adulto, uno de los grupos más vulnerables.

Es interesante comprobar cómo un modelo lineal simple captura patrones históricos bien documentados.

5️⃣ Aprendizaje clave

Este ejercicio refuerza una idea fundamental en machine learning:

Más variables no implican necesariamente mejor modelo.

En problemas con pocas muestras, controlar la complejidad puede ser más importante que aumentar el número de características.

La regularización no es solo un término matemático; es una herramienta práctica para gestionar el equilibrio entre sesgo y varianza.

🔜 Próximo paso

En el siguiente cuaderno abordaré la validación cruzada y la selección de hiper-parámetros para evaluar el modelo de forma más rigurosa.

Este primer baseline tenía un objetivo claro: entender cómo la regularización modifica la estructura del modelo.

🔗 Enlaces

-

🔗 Kaggle (English version): https://www.kaggle.com/code/jesusnieto/titanic-logisticregression-baseline

-

🔗 Colab (versión en español): https://colab.research.google.com/drive/1yhd8c2pdCf9GJ2VbSaWFhjgm1y2C_5A0