Artículo

🧠 Píldoras LLM #07 — Usa cualquier modelo del Hub en un pipeline

Se corresponde con el capítulo 1 del curso de Hugging Face

🔗 ✨ Ver cuaderno en 🟠 Google Colab

🔍 Más allá del modelo por defecto

Hasta ahora hemos usado el modelo por defecto que Hugging Face asigna a cada pipeline (o alguno sencillo en español), pero una de las mayores ventajas del ecosistema es que puedes elegir cualquier modelo del Hub y cargarlo directamente en tu código.

Esto te permite probar, comparar resultados y encontrar el modelo que mejor se adapte a tu caso de uso específico.

🗺️ Cómo hacerlo paso a paso

-

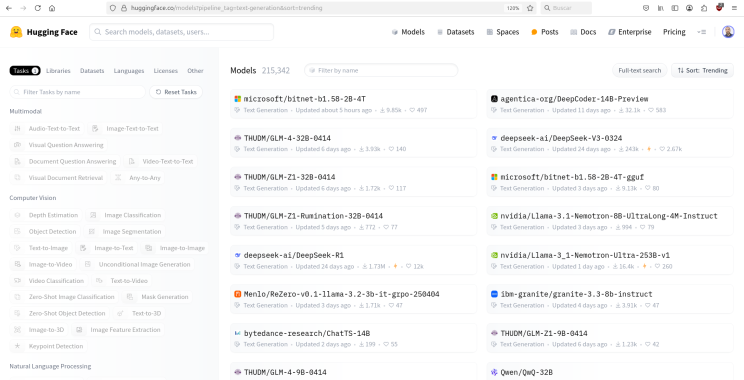

🌐 Ve al Hub de modelos de Hugging Face.

-

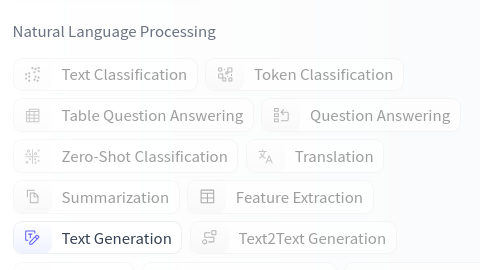

📊 Usa el menú de la izquierda para filtrar por tarea. En este caso, selecciona Text Generation dentro de Natural Language Processing.

- 🔍 Explora las distintas opciones disponibles. Verás modelos entrenados para diferentes idiomas, tamaños y propósitos.

👉 Por ejemplo, vamos a probar con el modelo distilgpt2, una versión más ligera de GPT-2 optimizada para generar texto de forma eficiente.

⚙️ Ejemplo de uso en un pipeline

from transformers import pipeline

# Usamos un modelo específico desde el Hub

generator = pipeline(

"text-generation",

model="distilgpt2"

)

print(generator("In this course, we will teach you how to", max_new_tokens=50))✅ Como ves, solo necesitas especificar el nombre del modelo en el parámetro model del pipeline, y automáticamente se descargará y cargará desde el Hub. Como respuesta nos devolverá un diccionario como el siguiente:

[{'generated_text': 'In this course, we will teach you how to use the command line, so it’s a bit complex, which is important, but at the same time it’s a really important task. But if you have any questions about this, then check out.‡\n\nOnce'}]🧠 Consejo práctico

💡 No te limites a un solo modelo. Probar alternativas te ayuda a entender cómo cambia el estilo, la coherencia y la calidad del texto generado.

Algunos modelos están optimizados para creatividad, otros para precisión, y algunos han sido ajustados para trabajar en idiomas específicos o en contextos técnicos.

🧩 Experimenta tú mismo

🔎 Explora otros modelos del Hub y repite el ejercicio:

- Cambia el modelo y observa cómo varía el estilo de salida.

- Prueba modelos en español o en otros idiomas.

- Ajusta el parámetro

max_new_tokenspara controlar la longitud de la generación.

⚠️ Tenlo en cuenta

Recuerda que modelos más grandes suelen ofrecer resultados más naturales, pero también implican:

- 💾 Mayor uso de memoria

- ⏱️ Más tiempo de cómputo

- ⚡ Mayor consumo energético

- 💰 Y, en entornos reales, más coste

🌍 Además, no olvides el impacto ambiental: más cómputo = más huella de carbono.