Artículo

🧠 Píldoras LLM #08 — Model Card

Se corresponde con el capítulo 1 del curso de Hugging Face

🔗 ✨ Ver cuaderno en 🟠 Google Colab

📊 ¿Qué es una Model Card?

Cada modelo en el Hub de Hugging Face incluye una ficha técnica detallada llamada Model Card. Esta información es clave antes de elegir un modelo, ya que te permite conocer sus:

- idioma

- tamaño

- arquitectura

- objetivos

- limitaciones

- y licencias

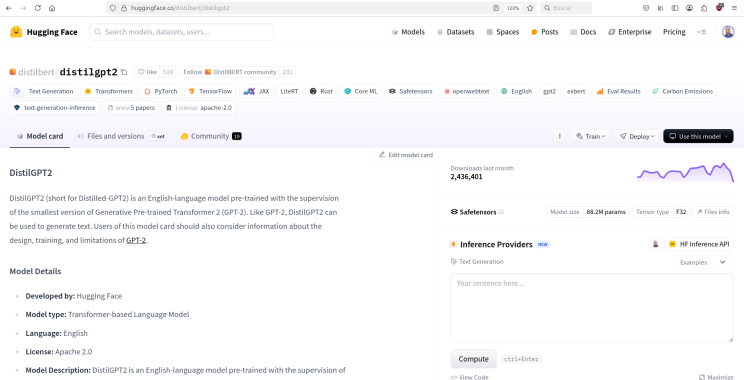

En esta píldora exploraremos la Model Card de distilbert/distilgpt2 — un modelo muy usado para generación de texto ligera.

🧠 Descripción general del modelo distilgpt2

Distilgpt2 es una versión reducida (distilled) del conocido modelo GPT-2, creada para ser más rápida y ligera sin perder demasiada calidad en tareas de generación de texto.

🏗️ Arquitectura

- Basada en GPT-2, pero con 6 capas en lugar de 12.

- Esta reducción disminuye significativamente el tamaño del modelo y el consumo de recursos computacionales.

📚 Entrenamiento

Fue entrenado usando knowledge distillation: aprende a imitar las predicciones del modelo GPT-2 original para mantener un rendimiento similar con muchos menos parámetros.

📦 Tamaño del modelo

Alrededor de 82 millones de parámetros, frente a los 124M+ de GPT-2 estándar.

✅ Esto lo hace ideal para entornos con recursos limitados, como CPU o notebooks de Google Colab.

💡 Uso principal

- Generación de texto en inglés.

- Completar frases, redactar contenido o continuar prompts de forma coherente.

⚠️ Limitaciones

- 📉 Solo entrenado en inglés (aunque puede reconocer palabras en otros idiomas).

- 🧠 No tiene conocimiento posterior a 2019.

- 🤖 Como cualquier modelo GPT, puede generar información incorrecta o sesgada.

🧪 Uso recomendado

Ideal para:

- 🚀 Prototipado rápido

- 🧪 Experimentación ligera

- 💻 Aplicaciones que requieren rapidez y bajo consumo de recursos

⚖️ Licencia

📜 Apache 2.0 — puedes usarlo, modificarlo y distribuirlo incluso en productos comerciales, siempre que se incluya la atribución correspondiente.

Recuerda revisar siempre la licencia de cada producto que decides usar, sobre todo con fines lucrativos.

🧠 Consejo práctico

Antes de elegir un modelo en el Hub, lee siempre su Model Card. Ahí encontrarás información que puede marcar la diferencia en rendimiento, idioma, requisitos técnicos y permisos de uso.

✅ 🧠 Checklist — Cómo leer una Model Card antes de usar un modelo

Antes de integrar cualquier modelo en tu proyecto, revisa estos 5 puntos clave 👇:

📚 1. Descripción general:

- Entiende qué hace el modelo y para qué tareas está diseñado.

- Pregúntate: ¿se ajusta a mi caso de uso? ¿Es de propósito general o específico?

🧠 Idioma y dominio:

- Verifica en qué idioma fue entrenado y en qué contexto.

- ⚠️ Un modelo entrenado solo en inglés no funcionará igual de bien con textos en español o técnico.

⚙️ Tamaño y requisitos:

- Revisa el número de parámetros, tamaño del modelo y si necesita GPU.

- Esto influye directamente en el rendimiento, coste y tiempo de inferencia.

⚠️ Limitaciones conocidas:

- Revisa posibles sesgos, fechas del dataset, versiones del modelo o restricciones.

- Esto te ayuda a entender qué no deberías esperar del modelo.

📜 Licencia de uso:

- Comprueba si puedes usarlo en producción, modificarlo o incluirlo en productos comerciales.

- ⚠️ En proyectos reales, este punto es tan importante como la precisión.

💡 Recuerda, más allá de la teoría ...

🔗 ✨ Ver cuaderno en 🟠 Google Colab

En el cuaderno de Google Colab que acompaña a esta píldora encontrarás casos de uso prácticos del modelo distilgpt2: generación de texto, prompts personalizados, y ejemplos de integración en código real.

Te animo a abrirlo, ejecutar los ejemplos y probar tus propias ideas.

💻 La mejor forma de entender un modelo… ¡es verlo en acción!